Adjunkt ved Forsvarsakademiet Iben Yde: Hvis ikke Danmark får udviklet en strategi for militær anvendelse af kunstig intelligens, vil andre lande komme til at definere den for os

04.07.2020

.„Kunstig intelligens er det nye sort i forsvarspolitik, men så længe Danmark tøver med at levere en strategi eller vedtage officielle retningslinjer for militær anvendelse af kunstig intelligens, begrænser vi vores muligheder for at få medbestemmelse på slutprodukterne og fællesstandarderne, hvilket næppe er ønskeligt.‟

Interview af Christiern Santos Rasmussen

RÆSON: Hvad er AI (kunstig intelligens), og hvordan kan det appliceres i det danske forsvar?

YDE: Når man taler om kunstig intelligens i forsvarssammenhæng, er det primært forskellige former for machine-learning, der kan anvendes på en lang række områder. Lige nu handler det først og fremmest om at forbedre håndteringen og udnyttelsen af de støt voksende datamængder for at skabe et bedre grundlag at handle ud fra. Det er vigtigt at understrege, at der er klart størst fokus på snæver eller opgave-specifik kunstig intelligens; dvs. anvendelsen af kunstig intelligens i en klart afgrænset funktion eller opgave.

Den mere generelle kunstige intelligens – altså tanken om at skabe kunstig intelligens, der kan løse en bred vifte af opgaver inspireret af den menneskelige intelligens – synes ikke at optage megen plads i hovedparten af de militære bestræbelser på at implementere kunstig intelligens. Når vi taler om militær anvendelse af kunstig intelligens, er der særligt tre områder, der er størst internationalt fokus på lige nu. Det er primært her, kunstig intelligens har størst potentiale og er mest mulig at implementere.

Det første område er logistik, hvor man bl.a. kan bruge kunstig intelligens som støtte til at optimere processer og leveringskæder; fx ved at spore forsyninger, identificere potentielle flaskehalse, nedsætte leveringstid og lave mere effektiv lagerstyring. Lige nu er udfordringen for Danmark og mange andre lande, at vi har masser af logistisk data, men samtidig mangler instrumenterne til at udnytte de potentielt værdifulde og meget store mængder af data. Kunstig intelligens vil formentlig også kunne bruges til mere end blot beslutningsstøtte i logistisk planlægning: bl.a. strategisk vedligeholdelse, hvor det kan hjælpe os til at blive endnu bedre til at forudsige, hvor langt vi kan presse vores udrustning og materiel, og hvornår der er behov for udskiftninger eller reparationer.

Det giver også mulighed for at skabe ubemandede platforme med en høj grad af autonomi, der vil lette den såkaldte ’last-mile logistik’ – det vil sige leveringen af forsyninger til den sidste mand i farlige områder, hvor der bliver skudt med de tungeste skyts. Det kunne være ubemandede platforme som fx selvkørende lastbiler, der kan bringe forsyninger ud til vores folk i områder med kamphandlinger, og som er i stand til at identificere farer i form af fx improviserede sprængladninger og ekstreme vejrforhold samt kan udføre andre risikable aktiviteter. Det er utvivlsomt løsninger, der vil være efterspurgte, fordi det at kunne gennemføre denne del af logistikken uden soldaters fysiske medvirken vil kunne spare både penge og menneskeliv.

Idéen om kunstigt intelligente platforme og systemer, der selv kan (…) træffe beslutninger og gennemføre angreb på baggrund heraf ligger så tæt på kendte fremtidsdystopier som Blade Runner og Terminator, at mange folk instinktivt nærer dyb modvilje mod dem

_______

Det andet område, som er særligt interessant i forhold til kunstig intelligens, er ønsket om at kunne skabe et operativt situationsbillede- og overblik over den samlede kampplads, baseret på overvågning, efterretninger og information fra en stadig større og mere forskelligartet mængde kilder, som vi kalder for C4ISR (Command, Control, Communications, Computers, Intelligence, Surveillance, and Reconnaissance). Der er ingen tvivl om, at effektiv informationshåndtering bliver stadig vigtigere i takt med, at mængden af data og kompleksiteten på kamppladsen stiger. Hvis det er muligt at udnytte kunstig intelligens’ store potentiale i forhold til dataanalyse og dermed skabe bedre og ikke mindst hurtigere overblik for militære beslutningstagere, vil det være enormt værdifuldt.

Det tredje område er anvendelsen af kunstig intelligens i forbindelse med våbensystemer, hvor der både er fokus på autonome platforme som droner, ubemandede kampvogne og software til fx måludpegning. Det er særligt de helt uafhængige våbensystemer, som kan udvælge og angribe mål uden behov for menneskelig indblanding efter aktivering af systemet, der har været genstand for opmærksomhed og kontroverser grundet de mange retlige og etiske udfordringer, det medfører. Idéen om kunstigt intelligente platforme og systemer, der selv kan navigere, bevæge sig, indsamle og analysere data fra egne og eksterne censorer samt træffe beslutninger og gennemføre angreb på baggrund heraf ligger så tæt på kendte fremtidsdystopier som Blade Runner og Terminator, at mange folk instinktivt nærer dyb modvilje mod dem.

Paradoksalt nok er det ikke fuldt ud autonome våbensystemer – hvordan man så end definerer dem – der får mest opmærksomhed i militære kredse. Desuden har jeg svært ved at forestille mig, at nogen statsmagt skulle være interesseret i at afgive enhver form for kontrol over et våbensystem til kunstig intelligens. Opmærksomheden er derimod rettet mod udvikling af maskinlæringsdrevet, automatiseret målgenkendelse, der skal sætte forskellige typer systemer i stand til selv at identificere mål og gennemføre angreb. Det vil fjerne behovet for, at de funktioner varetages af mennesker. Lignende teknologi eksisterer allerede, men forventningen er, at man vil kunne lave systemer, der er endnu bedre til at genkende forprogrammerede mål eller forskellige kategorier af objekter ved brug af en kombination af forskellige typer maskinlæring.

Der er generel enighed om, at fuldt autonome våbensystemer ikke er lige på trapperne; både fordi teknologien endnu ikke er moden, og fordi der er så mange uafklarede etiske og juridiske spørgsmål forbundet hermed. Derfor tror jeg også generelt, at de fleste stater vil være mere tilbøjelige til at implementere teknologi baseret på kunstig intelligens i afgrænsede eller lav-risiko funktioner – i hvert fald indtil vi bliver mere fortrolige med kunstig intelligens i militær kontekst.

Hvis Danmark investerer og planlægger rigtigt, kan vi potentielt spille en større rolle militært, end vores størrelse egentlig tilsiger og opnå mere indflydelse, end vi har i dag

_______

RÆSON: På den måde kan kunstig intelligens spille en rolle på næsten alle lag og funktioner i forsvaret. Hvad tror du kunstig intelligens vil betyde for et lille land som Danmark?

YDE: Det er klart, at Danmark som et lille land har begrænsede ressourcer og dermed også begrænsede muligheder i forhold til kunstig intelligens. Ikke mindst, fordi verdens største militærmagter har øjnene fast rettet mod at dominere området og derfor investerer voldsomt i forskning og udvikling af forskellige kunstig intelligensbaserede systemer. Men teknologi generelt og kunstig intelligens især betragtes af mange som faktorer, der kan øge kampkraften betydeligt. Så hvis Danmark investerer og planlægger rigtigt, kan vi potentielt spille en større rolle militært, end vores størrelse egentlig tilsiger og opnå mere indflydelse, end vi har i dag. Vi har jo en forsvarsindustri, der er temmelig højteknologisk og kompetent, selvom den er relativt lille.

Der er mange ting, der spiller ind i sådanne overvejelser. For det første er teknologien stadigvæk i mange henseender umoden. For det andet handler det ikke kun om, hvad vi selv gør. Vores nære allieredes adfærd vil også have betydning for os og vores muligheder. Danmark er med andre ord nødt til at se sig selv som del af en større sammenhæng, og derfor betyder hensynet til interoperabilitet [forskellige staters militære enheders samarbejdsevne, red.] også relativt meget, da vi er nødt til at kunne samarbejde med vores partnere, hvilket bl.a. kræver materiel, der kan tale og fungere sammen.

Eftersom der ikke på nuværende tidspunkt findes en reel dansk strategi for militær brug af kunstig intelligens, som sammentænker, hvad potentialet er for Danmark, og hvad forsvaret egentlig vil og ikke vil med kunstig intelligens, er det meget svært at give kvalificerede bud på, hvordan feltet vil udvikle sig; udover at vi formentlig som mange andre lande vil starte i det små med at implementere teknologierne i snævert afgrænsede funktioner. Det kunne fx være på det logistiske område eller i forhold til datahåndtering på efterretningsområdet.

Hvis ikke Forsvaret foretager sig noget, frygter jeg, at man mister råderum, fordi andre aktører kommer til at definere, hvad der er acceptable anvendelsesmuligheder

_______

Men Danmark har faktisk en national strategi for kunstig intelligens, der blev offentliggjort i marts 2019. Jeg tror, det ville være en god idé for Forsvaret at komme på banen med en militærspecifik udmøntning af den; ikke mindst fordi den nationale strategi specifikt nævner, at kunstig intelligens ikke må gøre skade på mennesker, hvilket nok kommer til at stå i vejen for Forsvarets anvendelse i visse funktioner. Her giver det mening, at Forsvaret selv kommer med et bud på, hvordan princippet om ikke at gøre menneskelig skade skal forstås på det militære område. Forsvaret kunne fx tilkendegive en hensigt om aldrig at tillade beslutninger om angreb uden en høj grad af menneskelig involvering, så at kunstig intelligens aldrig direkte gør skade på mennesker, men i stedet fungerer som beslutningsstøtte. Hvis ikke Forsvaret foretager sig noget, frygter jeg, at man mister råderum, fordi andre aktører kommer til at definere, hvad der er acceptable anvendelsesmuligheder.

Mange af vores nære allierede, herunder USA, Frankrig og Storbritannien, har allerede udgivet delvist offentligt tilgængelige strategier for militær anvendelse af kunstig intelligens. Derfor virker det besynderligt, at vi intet melder ud. Der findes i dag en frygt for at komme til at begrænse os selv ved at lave retningslinjer om noget, vi har meget begrænset viden om, fordi vi fortsat befinder os i de tidlige stadier. Den frygt kan desværre komme til at stå i vejen for arbejdet med at lave en dansk militærspecifik strategi for anvendelsen af kunstig intelligens. Selvom frygten i et vist omfang er begrundet, er det ærgerligt, hvis den begrænser os for meget.

Strategien behøver nemlig ikke nødvendigvis at være så detaljeret, at vi kommer til at spænde ben for os selv ved at afskære os fra anvendelsesmuligheder, der senere kan vise sig værdifulde. Man kan lade sig inspirere af de generelt teknologi-neutrale folkeretlige regler om krigsførelse; bortset fra reglerne om specifikke våben som kemiske våben og klyngevåben, er de teknologineutrale. De forbyder i stedet specifikke udfald ved at give en række forholdsregler, som gælder, uanset hvilke våben og metoder, Forsvaret bruger. Af den grund er de folkeretlige regler ikke forældede, men har formået at følge med de dramatiske teknologiske landvendinger, vi har set de sidste årtier.

Det er klart, at Danmark, hvis man ønsker at indgå i sådanne samarbejder, ikke på egen hånd kan diktere de forhold (for kunstig intelligens) og langt hen ad vejen må indordne sig. Men for mig at se betyder det langt fra, at Danmark ikke har noget at skulle have sagt

_______

RÆSON: Betyder aspektet om interoperabilitet, hvor vores systemer skal kunne tale sammen med fx NATO’s systemer, at Danmark ikke har mulighed for at sætte standarder for vores egen brug af kunstig intelligens?

YDE: Ja og nej. Det danske forsvar er ret afhængige af vores koalitionspartnere i mange henseender, og det vil også gælde udvikling og anvendelse af kunstig intelligens. En af de mange udfordringer her er tilvejebringelse af og adgang til trænings- og testdata. Som bekendt kræver udviklingen af maskinlæringsbaserede algoritmer store mængder data og du skal træne algoritmerne, som du træner din hund, med masser af data og billedmateriale. Kvaliteten af din algoritme vil være den samme som den data, du fodrer den med – shit in, shit out. Lige nu er der derfor en del snak om potentielt samarbejde omkring deling af data og databaser til algoritmetræning.

Udover de mange praktiske problemer forbundet med sådanne ordninger, rejser de en række spørgsmål i forhold til, hvem der skal have adgang til hvilke data, hvad de må anvendes til, hvordan de skal håndteres etc. Det er klart, at Danmark, hvis man ønsker at indgå i sådanne samarbejder, ikke på egen hånd kan diktere de forhold og langt hen ad vejen må indordne sig. Men for mig at se betyder det langt fra, at Danmark ikke har noget at skulle have sagt og ikke har mulighed for at sætte vores egne standarder og grænser. Vi er vant til at indgå i og navigere koalitioner, hvor forskellige stater møder op med deres egne dagsordener og nationale forbehold, og vi samarbejder jævnligt med stater, der ikke er underlagt de samme begrænsninger som os; fx i forhold til våben som personelminer og klyngeammunition. Så med kompromis vil der naturligvis kunne findes løsninger.

RÆSON: Kunstig intelligens’ algoritmer former delvist sig selv samt den data, de fodres med, og ændrer dermed form hele tiden og udgør delvist en såkaldt „sort boks‟. Hvad betyder det, at man egentlig ikke ved, hvordan den beslutningstagende algoritme ser ud, ift. de standarder du nævner?

YDE: Sort boks-problemet er en kæmpe juridisk og etisk udfordring både i forhold til civil og militær anvendelse af kunstig intelligens. Helt grundlæggende skal vi tage stilling til, om vi vil acceptere at lade computere træffe afgørende beslutninger, uden at vi har mulighed for at forstå, hvordan beslutningen blev nået. Det er sådan set problematisk, uanset om der er tale om autonome systemer, der selv handler, eller om beslutningsstøttesystemer, som menneskelige operatører og beslutningstagere handler på baggrund af.

Problemet er det samme. Tør vi stole på, at algoritmen har ramt rigtigt? Fx kunne der være tale om måludpegningssoftware, der kategoriserer et bestemt individ som en kombattant og dermed en person, der kan angribes i henhold til den humanitære folkeret. Vi ved af erfaring, at det i visse situationer selv for mennesker er meget vanskeligt at skelne mellem kombattanter og civile. Derfor ville det være betryggende at kunne bede computeren om en forklaring på klassificeringen, så vi selv får mulighed for at vurdere de parametre, der har været afgørende for algoritmens konklusion. Ikke mindst fordi en fejlklassifikation i det her tilfælde kan betyde, at en uskyldig civil bliver gjort til genstand for et angreb, hvilket er både moralsk anstødeligt og ulovligt i henhold til folkeretten.

Det er ekstremt vanskeligt at afgøre, hvordan vi skal forholde os til denne problemstilling. På den ene side kan man argumentere for, at vi bør bruge systemer baseret på kunstig intelligens, uanset om vi forstår dem eller ej, hvis de i testfasen har vist sig at være bedre til at klassificere objekter eller individer korrekt end mennesker – fordi det netop vil kunne nedbringe antallet af fejlklassificeringer, der fører til drab af uskyldige. På den anden side kan man argumentere for, at det ikke er acceptabelt at anvende systemer, vi ikke kan opnå indsigt i ved at bruge nøjagtigt det samme argument; nemlig beskyttelse af civilbefolkningen, fordi risikoen for fejl i systemet netop kan resultere i drab på civile. Det argument bliver dog svagere, hvis det pågældende system klarer sig konsistent overbevisende i testfasen.

Mange mener, at vi vil stå overfor et tradeoff mellem forklarlighed og effektivitet og nøjagtighed i systemets forudsigelser, fordi forklarlighed og gennemsigtighed formentlig vil kræve, at man laver systemer med en lavere grad af kompleksitet

_______

I øvrigt er en af de helt store emner inden for kunstig intelligens netop såkaldt forklarlig kunstig intelligens, der skal muliggøre menneskelig indsigt i systemets beslutninger og dermed eliminere den sorte boks. Men forklarlig kunstig intelligens er en relativ ny forskningsgren, og mange mener, at vi vil stå overfor et tradeoff mellem forklarlighed og effektivitet og nøjagtighed i systemets forudsigelser eller klassificeringer, fordi forklarlighed og gennemsigtighed formentlig vil kræve, at man laver systemer med en lavere grad af kompleksitet.

Uanset hvordan vi vælger at forholde os til sort boks-problemet, tror jeg, at testning vil blive stadig mere afgørende. Om vi forstår de underliggende algoritmer i fx et våbensystem eller ej, kan vi kan nemlig måle effekten og dermed nøjagtighed via tests og opstille klare parametre for, hvornår systemets performance er god nok til, at vi vil bruge det i den virkelige verden. Men det er både svært og dyrt at teste nye systemer, og de problemer bliver ikke mindre, når vi taler om kunstig intelligens. Derfor er der et stort potentiale for internationalt samarbejde om testfaciliteter og metoder. En række stater har allerede eksplicit adresseret behovet for samarbejde omkring gennemførelsen af de våbenscreeninger, som folkeretten stiller krav om.

RÆSON: Skaber denne mangel på transparens ikke også et problem ift. placering af ansvar? Hvis fx en autonom drone ender med at dræbe civile: Hvem har ansvaret, når vi ikke forstår, hvorfor dronen gjorde, som den gjorde?

YDE: Jo, ansvarsproblemet er bestemt en stor udfordring. Men jeg er ikke enig med dem, der argumenterer for eksistensen af et ansvarsvakuum i forbindelse med anvendelsen af kunstig intelligens i våbensystemer og andre systemer. Selvom det er korrekt, at det vil blive sværere at placere det strafferetlige ansvar for et kunstig intelligens-baseret systems handlinger mod en enkeltperson, fordi kompleksiteten stiger, og forudsigeligheden dermed daler, findes der stadig andre muligheder.

For det første er udgangspunktet i folkeretten og dansk militær strafferet, at den militære chef, der har ansvaret for beslutninger om, hvordan et angreb gennemføres, også er ansvarlig for valg af våben. Viser det sig, at chefen har valgt et våben, der i den pågældende situation er ulovligt, bærer vedkommende ansvaret for det valg – også hvis der er tale om et våbensystem baseret på kunstig intelligens.

For det andet vil der i situationer, hvor systemet er fejlbehæftet, være tale om produktansvar hos producenten. Man kunne overveje at indføre skærpet produktansvar for kunstig intelligens-baserede systemer, der vil gøre producenten ansvarlig for enhver fejl. Udfordringen i forhold til produktansvar er dog, at de ændringer, der sker i systemet efterhånden, som det lærer og tilpasser sin adfærd kan være svære at holde producenten ansvarlig for: Kan man holde producenten ansvarlig for et system, der har ændret sig betydeligt, siden det blev solgt?

For det tredje er stater generelt ansvarlige for overtrædelser af folkeretten i forbindelse med militære operationer, og ligesom med produktansvar kunne man overveje at vedtage et skærpet eller ligefrem objektivt ansvar for anvendelsen af kunstig intelligens i militære operationer, dvs. hvor fx staten Danmark eller den enkelte beslutningstager påtager sig ansvaret for enhver fejl, der måtte begås under en operation. Endelig vil der efter omstændighederne også være mulighed for at placere et ansvar hos programmører og/eller operatører, i det omfang de har handlet i strid med loven.

Uanset hvad opfattes det generelt som overordentligt positivt, at det overhovedet er lykkedes at skabe dialog mellem særligt USA og Kina på det her meget følsomme sikkerhedspolitiske område

_______

RÆSON: De her overvejelser og udviklingen af retningslinjer påvirkes vel også af et internationalt kapløb om brug af kunstig intelligens, hvor andre aktører ikke nødvendigvis har de samme bekymringer som os?

YDE: Der er helt klart bekymringer om våbenkapløb og mangel på fælles standarder for militært brug af kunstig intelligens. Jeg er selv med i et internationalt forskersamarbejde omkring retningslinjer for militært brug af kunstig intelligens med særligt fokus på våbensystemer, der bl.a. inkluderer forskere fra Kina og USA, og vi er faktisk alle ret enige om udfordringerne langt henad vejen. Selvom der er tale om et uformelt ekspertsamarbejde, er vi ved at udvikle et forslag til fælles internationale retningslinjer for militær anvendelse af kunstig intelligens for at opbygge gensidig tillid og øget transparens og dermed sænke risikoen for konflikt og global ustabilitet.

Dele af projektet er inspireret af tilgangen til masseødelæggelsesvåben som atomvåben og nogle af de mulige instrumenter, vi har kigget på, er deling af testresultater, udarbejdelse af fælles teststandarder, minimumskrav til datastandard, mærkning af våbensystemer, der angiver graden af autonomi i et system og forbud mod brug af autonome våbensystemer i omstridte områder; fx det Sydkinesiske Hav.

Forhåbningen med samarbejdet er, at projektet med tiden kan udmøntes i fælles retningslinjer, som både Washington og Beijing kan bruge og måske endda inkorporere officielt. Udfordringen her bliver at skabe retningslinjer, der er konkrete og kunstig intelligens-specifikke nok til, at de reelt bidrager med noget, og samtidig at holde indholdet tilstrækkeligt generelt til, at staterne vil overveje at tilslutte sig retningslinjerne. Uanset om det kommer til at ske eller ej, opfattes det generelt som overordentligt positivt, at det overhovedet er lykkedes at skabe dialog mellem særligt USA og Kina på det her meget følsomme sikkerhedspolitiske område.

Samtidig er muligheden for at påvirke udviklingen af reguleringen på området endnu et argument for, at Forsvaret skal indtage en position ift. militær anvendelse af kunstig intelligens, som er en anelse mere proaktiv – både nationalt og internationalt. Så længe Danmark tøver med at levere en strategi eller vedtage officielle retningslinjer for militær anvendelse af kunstig intelligens, begrænser vi vores muligheder for at få medbestemmelse på slutprodukterne og fællesstandarderne, hvilket næppe er ønskeligt. Og det er vel egentlig heller ikke i overensstemmelse med den nationale strategis overordnede mål om, at Danmark skal gå forrest i ansvarlig udvikling og anvendelse af kunstig intelligens. ■

Så længe Danmark tøver med at levere en strategi eller vedtage officielle retningslinjer for militær anvendelse af kunstig intelligens, begrænser vi vores muligheder for at få medbestemmelse på slutprodukterne og fællesstandarderne

_______

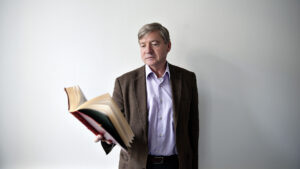

Iben Yde, f. 1981, er adjunkt i operativ folkeret ved Institut for Militær Teknologi, Forsvarsakademiet. ILLUSTRATION: To amerikanske militære dronefly fotograferet på Creech Luftbasen i Nevada, 5. maj 2015 [Foto: U.S. Air Force photo/Flickr/Staff Sgt. Vernon Young Jr.]

![Kampen om magten: „En meget berigende politisk bog […] Anbefales til indkøb‟](https://d.raeson.dk/wp-content/uploads/2020/02/usa.trump_-300x274.jpg)